Descarga el whitepaper de BPM Partners

Perspectivas sobre FP&A, IA y transformación financiera | Prophix Blog

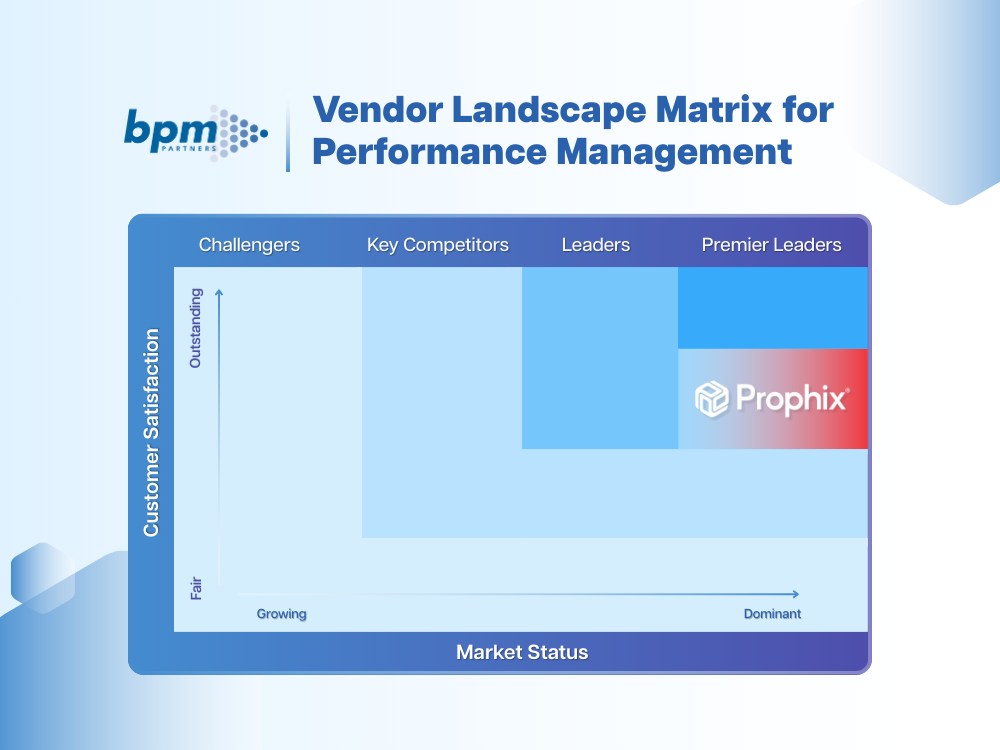

Agentes Prophix One: El primer paso hacia las finanzas autónomas

Prophix One Agents: su primer paso hacia las finanzas autónomas y un legado de claridad, capacidad y confianza.

Lee nuestra historiaInsights for next-gen finance leaders

Stay ahead with actionable finance strategies, tips, news, and trends.